tg-me.com/sqlhub/1898

Last Update:

📧🤖 ART: интеллектуальный e-mail-агент с памятью, действиями и "мыслями"

OpenPipe представили подробный разбор архитектуры ART (Action–Recall–Thought) — это не просто бот, а полноценный агент, который может читать письма, анализировать контекст, планировать действия и запоминать диалог. Такой себе LLM-секретарь, который не забывает, что вы писали неделю назад, и умеет реагировать правильно.

🧠 Что такое ART?

ART — это архитектура, построенная вокруг трёх основных элементов:

1️⃣ Action — агент может действовать: писать ответы, создавать события, ставить задачи, отправлять follow-up.

2️⃣ Recall — агент вспоминает: использует векторную память, чтобы помнить важные детали переписки.

3️⃣ Thought — агент думает: размышляет о контексте, выбирает нужные шаги и обновляет своё внутреннее состояние.

Каждый запуск агента — это один цикл мышления, в котором он анализирует новое письмо, сравнивает его с памятью и решает, что делать.

🧩 Как работает?

Архитектура построена на LangGraph — фреймворке для создания LLM-агентов с управляемыми потоками данных (узлы, переходы, состояния).

🧬 Компоненты:

- Nodes:

- Reader: разбирает новое письмо

- Memory Retriever: ищет релевантные воспоминания

- Planner: решает, что делать

- Executor: выполняет действия (ответ, событие и т.д.)

- Reflector: обновляет размышления агента

- Memory:

- Используется ChromaDB (векторная база), куда сохраняются ключевые сообщения, решения, действия и мысли.

- Tools:

- Встроенные функции-агенты (tools) для генерации писем, событий, напоминаний, оповещений и т.п.

- Всё вызывается динамически через LLM, как в OpenAI function calling.

🔁 Как агент работает на практике?

Пример цикла:

1. Приходит e-mail → Reader извлекает суть.

2. Memory Retriever ищет похожие прошлые переписки.

3. Planner решает: ответить? создать задачу? проигнорировать?

4. Executor выполняет нужное действие.

5. Reflector обновляет память и размышления.

Следующее письмо будет уже обрабатываться с учётом прошлого контекста. Агент понимает цепочку, тему, задачи и автоматически действует.

💡 Что делает ART особенным?

✅ Работает в несколько итераций, не просто «prompt → response»

✅ Помнит прошлые письма, решения, даже ошибки

✅ Сам планирует, что делать: отвечать, пересылать, напоминать

✅ Обновляет свои действия при изменении входных данных

✅ Настраивается под любые задачи: продажи, саппорт, личные письма, менеджмент

📎 Полный разбор от OpenPipe с примерами кода, схемами и демонстрацией:

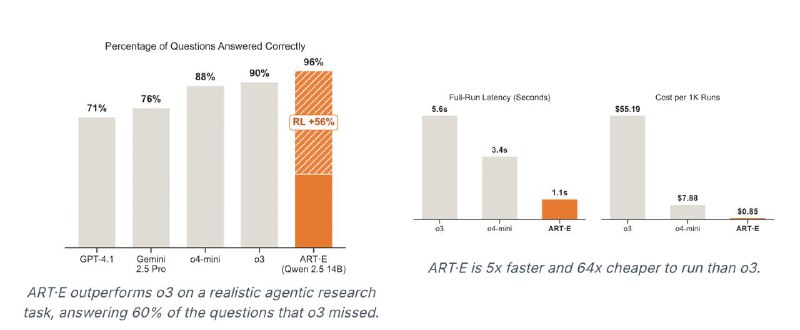

👉 https://openpipe.ai/blog/art-e-mail-agent

Если ты хочешь строить LLM-агентов с настоящей памятью и логикой — это must-read. Это шаг к настоящим автономным ассистентам.

#AI #LLM #autonomousagents #LangGraph #e-mail #productivity #openpipe #инструменты

@sqlhub

BY Data Science. SQL hub

Share with your friend now:

tg-me.com/sqlhub/1898